Men dataprogram som agerar terapeut är faktiskt inget nytt. Minns att jag som tonåring satt vid pappas ABC 80 och konverserade ”Psykoanalytikern Eva”. Skärmen var brun med orange text. Svaren var fåordiga, ofta bara omformuleringar av vad jag själv hade skrivit. ”Eva” hade en viss minnesförmåga. Ibland gjorde hon kopplingar till något tidigare. Jag kunde sitta i timmar.

Det här inlägget anknyter till en tidigare text om nutida AI-terapi via nätet.

“Psykoanalytikern Eva”

(Obs! Inget av det som skrivs sparas)

När jag funderade på sådana här AI-chatbottar mindes jag alltså att jag lekt med ett ganska primitivt liknande program på en av de första PC-datorerna. Detta bör ha varit i slutet av 70-talet eller strax därefter.

Söker på namnet som jag minns det, men får ingen träff. Tar hjälp av ChatGPT. Som scannar nätet kors och tvärs. Men inte heller den hittar några spår av “Psykoanalytikern Eva”.

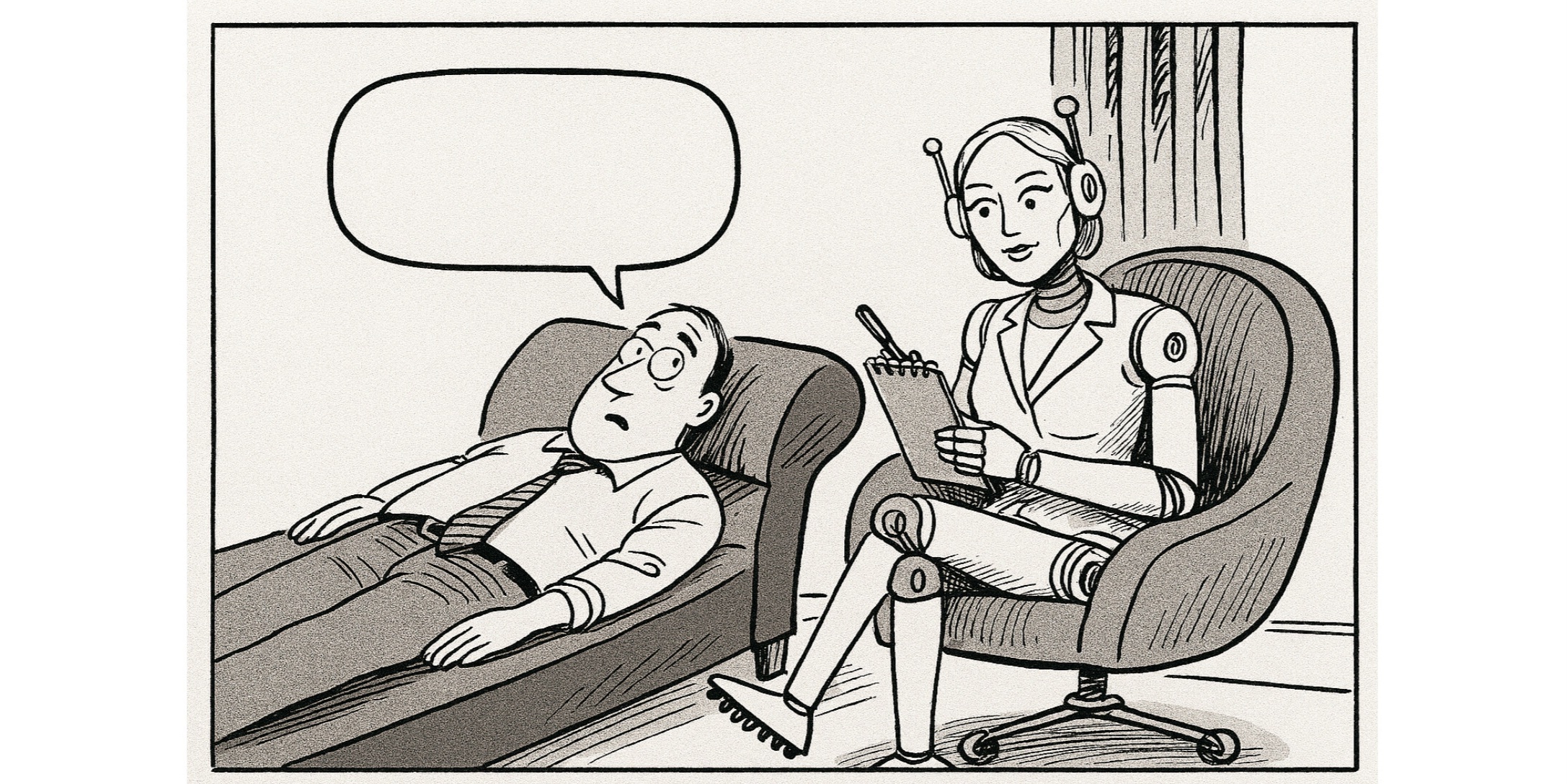

Jag försöker beskriva funktionerna som jag minns dem. Och detta växer ut till en intressant konversation. (Snart erbjuder sig ChatGPT även att skapa ett sådant program åt mig. Resultatet ovan!)

Tack – nu börjar bilden klarna, och det du beskriver påminner mycket om ett klassiskt program: ELIZA, men troligen i en svensk version med ett annat namn – t.ex. ”Psykoanalytikern Eva” som du minns det.

ELIZA var ett textbaserat program som skapades 1966. Det skrevs i Lisp på en IBM 7094, av Joseph Weizenbaum. Han skrev flera ”skript” för ELIZA. Det mest kända hette DOCTOR, och simulerade en Rogeriansk psykoanalytiker (Carl Rogers-metoden). Den svarade med speglingar av dina fraser utan riktig förståelse – men kunde kännas engagerande.

Det finns indikationer på att svenska varianter av ELIZA cirkulerade i skolor och på BBS:er under 1980‑talet – ibland med nya namn, som ”Psykoanalytikern Eva” (eller Anna, Lisa, m.fl.). Fanns på Commodore 64, Apple II, eller MS-DOS.

ELIZA är alltså ett textbaserat datorprogram som simulerade samtal med en människa – en slags tidig “chatbot”. Det är legendariskt och många anser att ELIZA är grunden till det vi idag kallar konversations-AI.

Trots sin enkelhet kändes ELIZA överraskande ”mänsklig” – särskilt eftersom psykoanalytikerrollen ofta använder öppna frågor och spegling. Detta skapade illusionen av förståelse.

Jag blir nyfiken på denne Joseph Weizenbaum och ChatGPT berättar:

Joseph Weizenbaum (1923–2008) var en tysk-amerikansk datavetare och en av pionjärerna inom artificiell intelligens (AI).

Han föddes i Berlin, men hans judiska familj flydde nazisterna till USA 1936. Han arbetade för General Electric på 1950-talet, bl.a. med bankdatorer. Blev senare professor vid MIT (Massachusetts Institute of Technology).

Joseph Weizenbaum blev chockad över att människor tog programmet på allvar. Många, även hans sekreterare, ville ha privata samtal med ELIZA/DOCTOR – som om det verkligen förstod dem. Han blev AI-kritiker efter det och skrev boken Computer Power and Human Reason (1976).

Weizenbaum argumenterar att vi bör vara försiktiga med att ge datorer makt över mänskliga beslut. Han menade att det finns en moralisk gräns för vad vi bör låta datorer göra – särskilt i psykologiska eller militära sammanhang.

Ps. Bilden högst upp är även den skapad i ett nafs av ChatGPT. Fritt utifrån en kort beskrivning av vad jag ville ha. DS.